AI는 흑인의 얼굴을 잘 인식하지 못한다?

조이 부올람위니는 MIT에서 컴퓨터 비전 기술을 활용하는 아트 프로젝트를 진행하고 있었다.

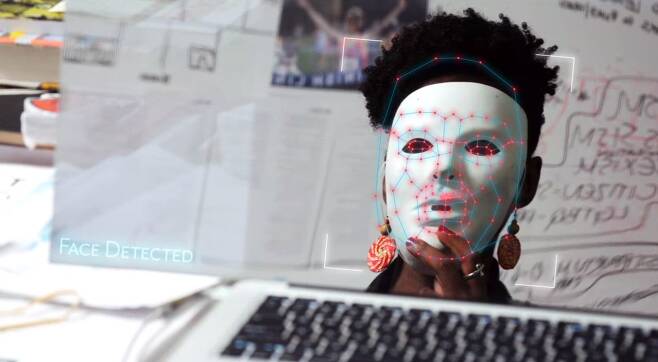

과제로 프로그램을 개발 중이던 조이 브올람위니는 얼굴을 추적하는 컴퓨터 비전 프로그램을 연결하던 중 이상한 점을 발견했다. 흑인인 자신의 얼굴은 인식하지 못하던 프로그램이 흰색 가면을 착용하니 감지가 되는 것이다.

놀랍게도 사람의 얼굴이 아닌 흰색 가면은 인식이 되지만, 진짜 사람의 얼굴인 그의 얼굴은 인식하지 못했다.

인식 기능의 정확도를 높이기 위해서는 최대한 많은 데이터를 통해 트레이닝 과정을 거쳐야 한다. 조이는 이 데이터 세트의 대다수가 밝은 피부색을 가진 남성이라는 걸 발견했다.

조이는 다른 소프트웨어로도 같은 테스트를 진행했다. 그 결과 그 알고리즘들은 여성의 얼굴보다 남자의 얼굴에서, 피부색이 어두운 것보다 밝은 피부일 때 더 잘 작동했다.

조이는 이를 통해 AI에도 사회적 편견이 개입한다는 사실을 알게 됐다. 편견을 가지지 않는다고 생각했던 기술도 결국 인간이 제공한 편중된 데이터에 의해 편향적으로 작용하게 된다는 것이다.

“우리가 기술과 사회에 대해 일반적이라고 보는 개념들은 사실 무척 극소수의 동질적인 사람들의 머리에서 나온 것이에요. 그런데 문제는 모두에게 무의식적인 편견이 있다는 것이죠. 그리고 사람들은 자신의 편견을 기술에 심었어요.” (매러디스 브루사드)

알고리즘이 편견을 가진다는 것은 우리가 생각하는 것 이상으로 우리의 생활에 영향을 미친다.

안면 인식 뿐만 아니라 수많은 정보들이 AI를 통해 걸러지고 구체화되어 우리에게 제공된다. SNS 계정의 피드에 뜨는 광고와 같은 사소한 것부터 뉴스, 영상, 책 추천 등 우리의 생각에 영향을 미치는 수많은 정보들이 AI의 통제를 받는다.

만약 AI가 학습한 정보가 편향적이었다면, 사람들에게 제공되는 정보 또한 편향성을 띌 수 있다.

제가 생각하는 알고리즘은 미래를 예측하기 위해 과거의 정보를 이용하는 거예요. '머신 러닝'이란 점수 시스템으로서 우리가 하려는 것의 가능성 점수를 매기는 것입니다. '이 대출금을 갚을 것인가? 이 직장에서 해고될 것인가?'

제가 AI에서 가장 우려하는 것은 힘입니다. 결국 그 코드를 누가 소유하느냐거든요. 그걸 소유한 사람들이 그걸 다른 사람들에게 사용해요. 균형이라곤 없죠." (캐시 오닐, '대량학살 수학무기' 저자)

실제로 편향적 데이터로 인해 문제가 발생한 사례가 있다. 미국 기업 아마존은 AI 기술을 채용에 이용했지만 결국 이 시스템을 폐기했다. 프로그램에서 여성 지원자에 대한 편견이 발견됐기 때문이다.

또 다른 사례도 있다. 유나이티드 헬스 케어의 프로그램에 의해 상대적으로 건강한 백인들이 상태가 더 위중한 흑인들에 비해 더 먼저 진료를 받게 됐다는 연구 결과가 발표됐다.

알고리즘이 감시의 도구로 사용되는 것에 대한 우려도 있다. 영국 런던에는 거리 곳곳에 수많은 안면 인식 카메라가 설치됐다. 수배자 검거나 범죄 수사에 사용하겠다는 목적이지만, 시스템이 편향적이라면 당연히 문제가 발생할 여지가 있다.

현재 안면인식기술은 100%의 정확도를 가지고 있지 않으며, 이 불완전한 기술이 감시도구로 사용될 경우 어떤 결과가 있을 지는 예상 가능하다.

편견이나 감정이 개입되지 않는 가장 공평한 도구라고 여겨졌던 AI의 잘 알려지지 않은 이면, 넷플릭스 오리지널 다큐멘터리 '알고리즘의 편견'이 이를 집중 조명했다.

이미 우리 삶에 깊이 개입하고 있는 알고리즘의 편향성이 불러올 문제점은 무엇인지, 한 번 깊이 생각해 볼 시간이 될 것.